파인튜닝할 수 있는 모델 목록은 OpenAI documentation을 참조하세요.

OpenAI Python API 설치 또는 업데이트

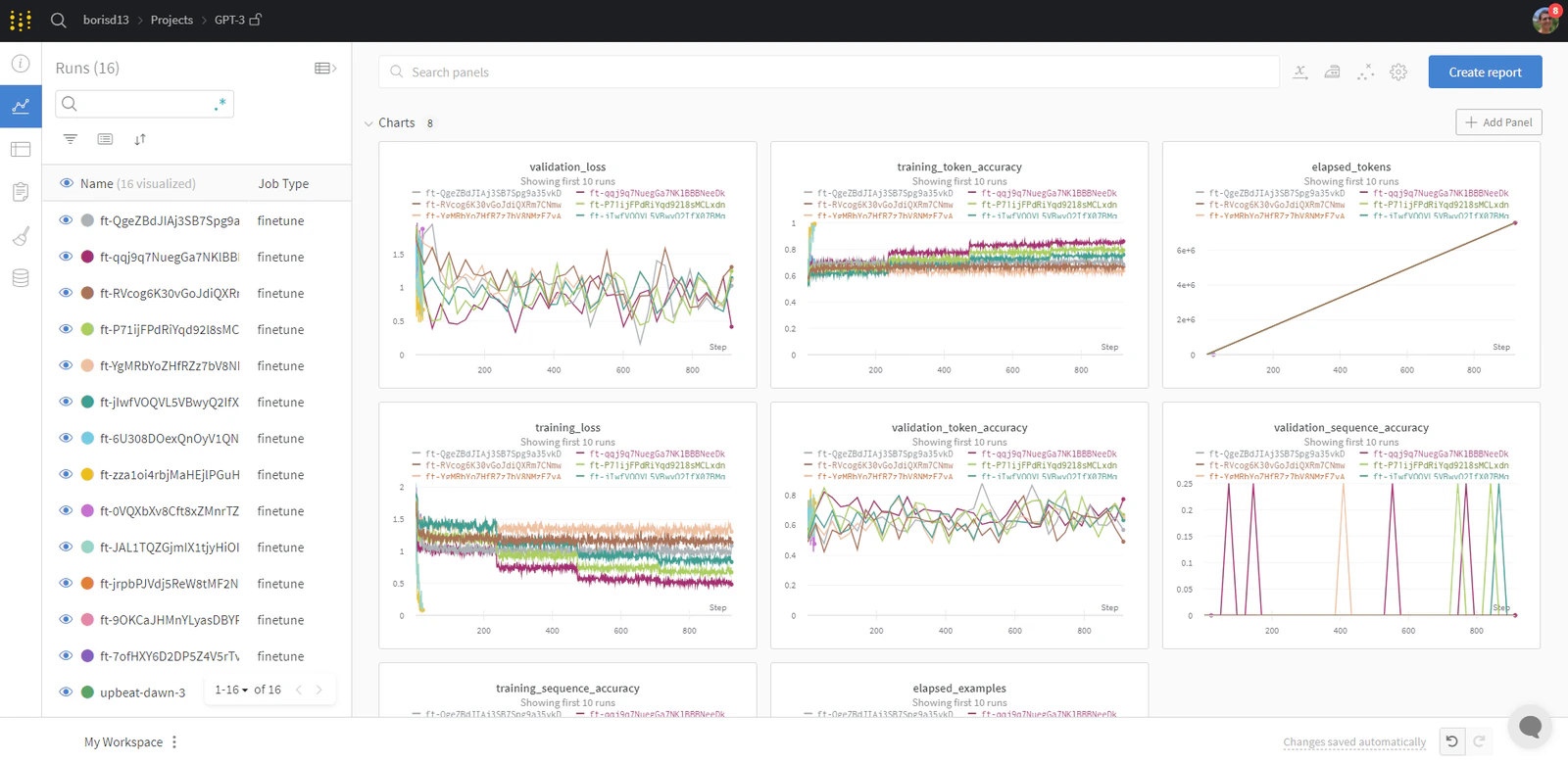

OpenAI 파인튜닝 결과 동기화하기

wandb.integration.openai.fine_tuning 모듈의 WandbLogger 클래스를 사용하세요.

파인튜닝 결과 동기화하기

레퍼런스

| Argument | 설명 |

|---|---|

| fine_tune_job_id | client.fine_tuning.jobs.create를 사용해 파인튜닝 작업을 생성할 때 받는 OpenAI Fine-Tune ID입니다. 이 매개변수가 None(기본값)이면, 아직 동기화되지 않은 모든 OpenAI 파인튜닝 작업이 W&B로 동기화됩니다. |

| openai_client | 초기화된 OpenAI 클라이언트를 sync에 전달합니다. 클라이언트가 제공되지 않으면 로거가 직접 클라이언트를 초기화합니다. 기본값은 None입니다. |

| num_fine_tunes | ID를 제공하지 않으면 동기화되지 않은 모든 파인튜닝이 W&B에 로깅됩니다. 이 매개변수를 사용하면 동기화할 최신 파인튜닝 개수를 선택할 수 있습니다. num_fine_tunes가 5이면 가장 최근 파인튜닝 5개를 선택합니다. |

| project | 파인튜닝 메트릭, 모델, 데이터 등이 로깅될 W&B 프로젝트 이름입니다. 기본 프로젝트 이름은 "OpenAI-Fine-Tune"입니다. |

| entity | run을 전송할 W&B 사용자 이름 또는 팀 이름입니다. 기본적으로는 기본 entity가 사용되며, 일반적으로 사용자 이름입니다. |

| overwrite | 동일한 파인튜닝 작업에 해당하는 기존 wandb run에 강제로 로깅하고 덮어씁니다. 기본값은 False입니다. |

| wait_for_job_success | OpenAI 파인튜닝 작업이 시작되면 보통 완료까지 다소 시간이 걸립니다. 파인튜닝 작업이 끝나는 즉시 메트릭이 W&B에 로깅되도록 이 설정은 60초마다 파인튜닝 작업의 status가 succeeded로 변경되었는지 확인합니다. 작업이 성공한 것으로 감지되면 메트릭이 자동으로 W&B에 동기화됩니다. 기본값은 True입니다. |

| model_artifact_name | 로깅되는 모델 artifact의 이름입니다. 기본값은 "model-metadata"입니다. |

| model_artifact_type | 로깅되는 모델 artifact의 유형입니다. 기본값은 "model"입니다. |

| **kwargs_wandb_init | wandb.init()에 직접 전달되는 추가 매개변수 |

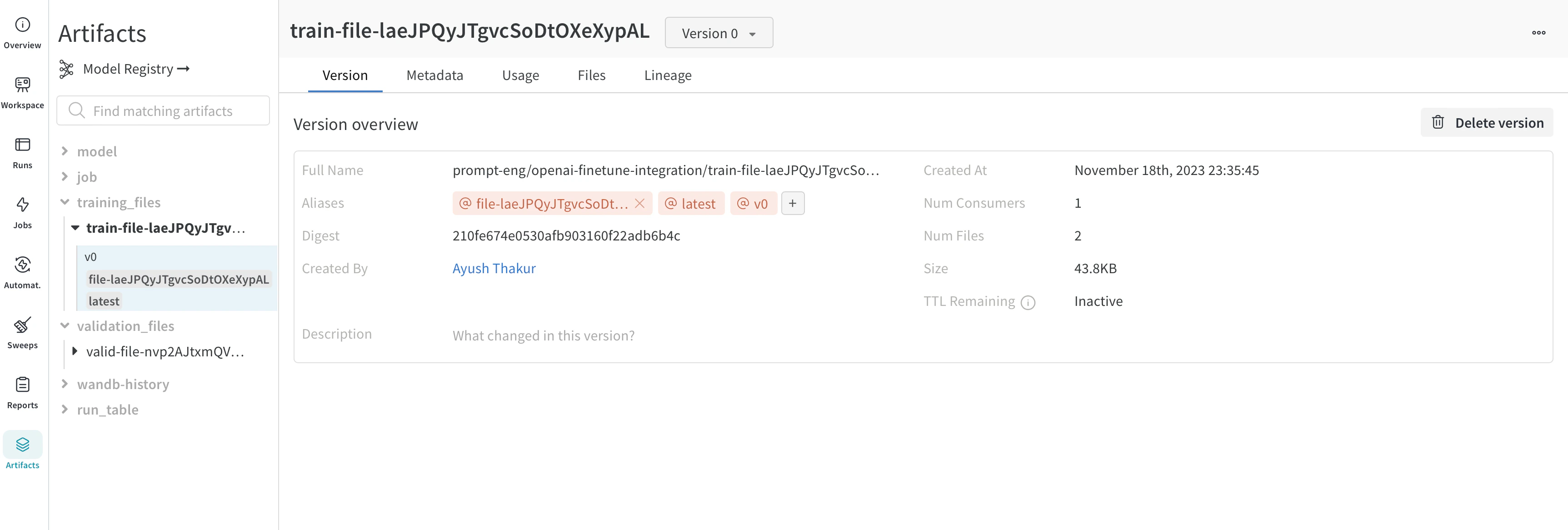

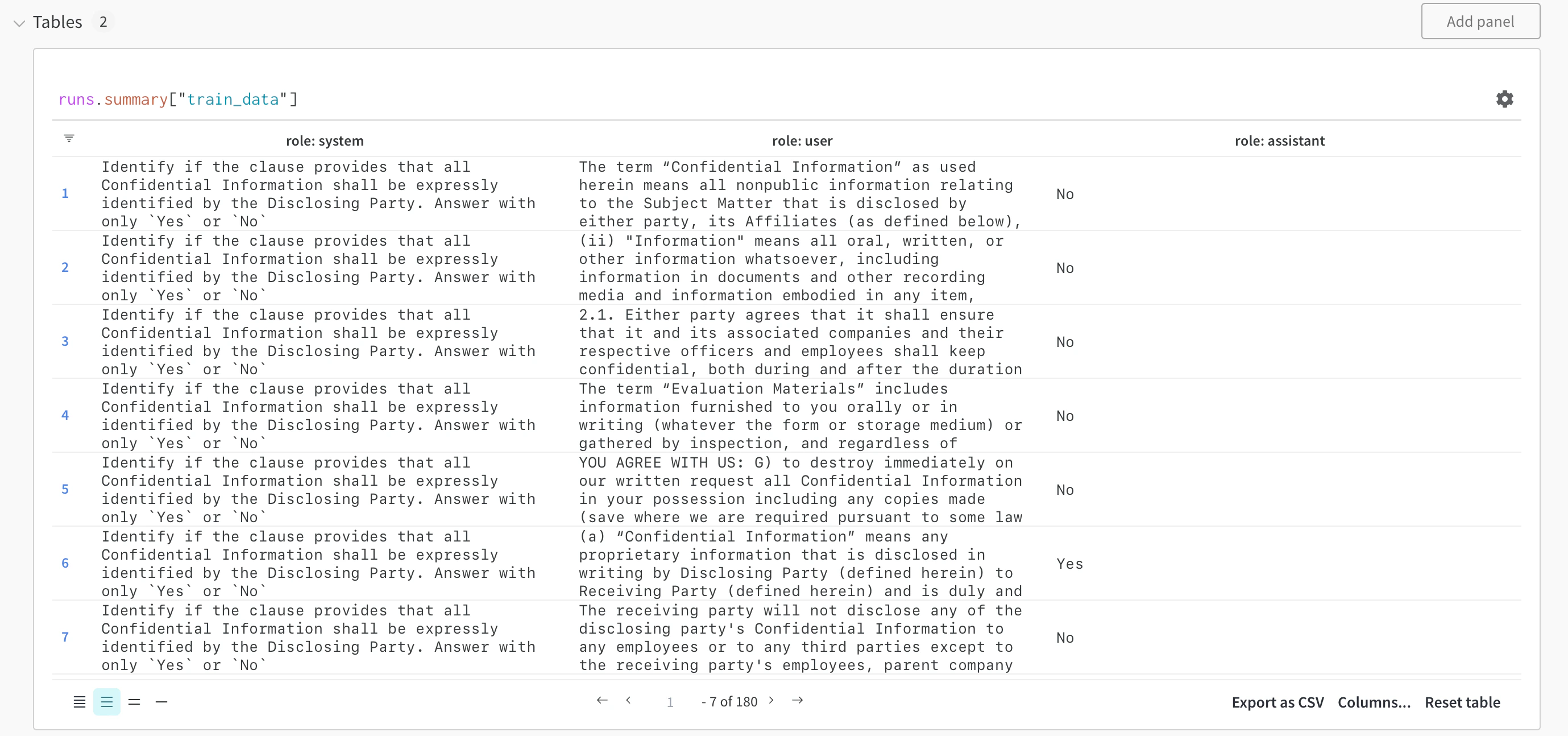

데이터셋 버전 관리 및 시각화

버전 관리

시각화

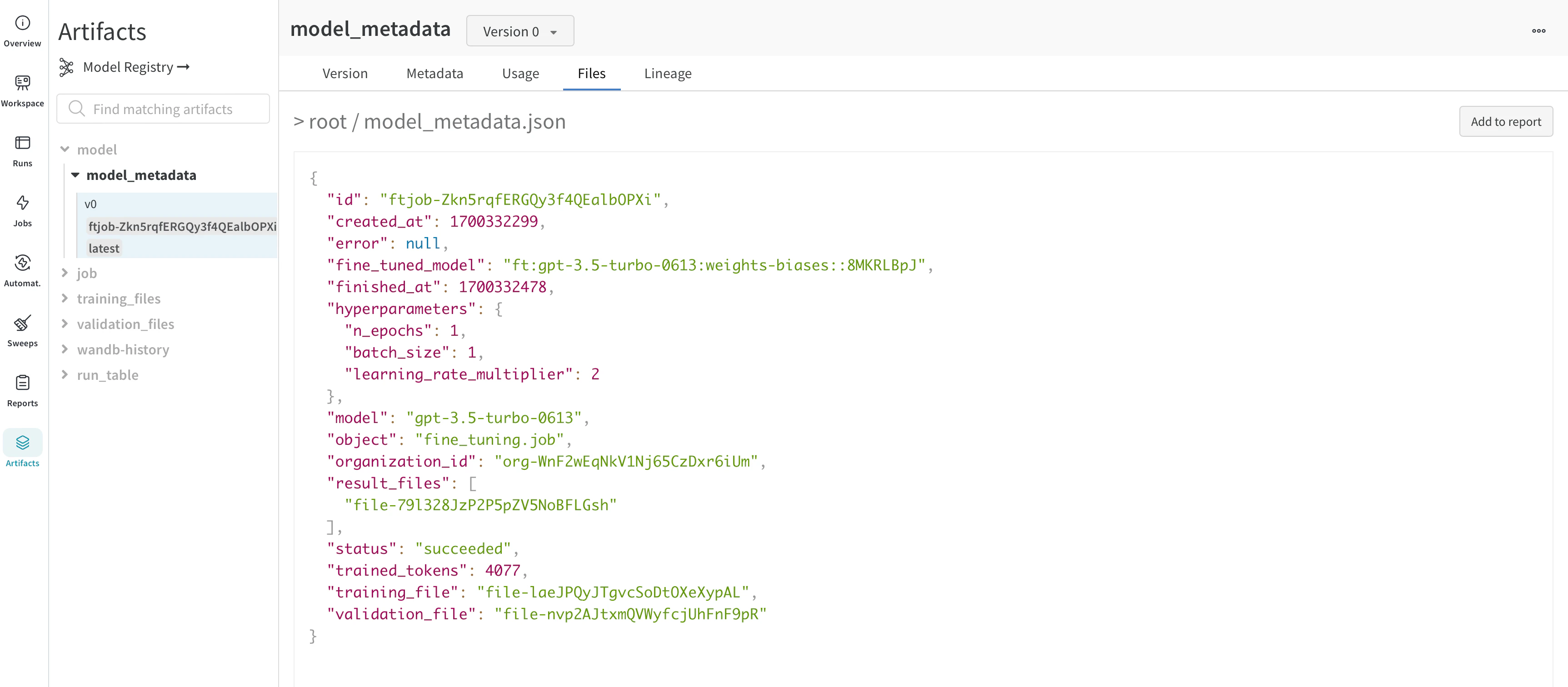

파인튜닝된 모델과 모델 버전 관리

WandbLogger는 모델의 모든 세부 정보(하이퍼파라미터, 데이터 파일 ID 등)와 fine_tuned_model`` ID가 포함된 model_metadata.json` 파일을 생성하고, 이를 W&B Artifact로 로깅합니다.

이 모델(메타데이터) Artifact는 W&B Registry의 모델에 추가로 연결할 수 있습니다.

자주 묻는 질문

run을 어떻게 정리할 수 있나요?

파인튜닝한 모델에 어떻게 액세스할 수 있나요?

model_metadata.json)와 설정으로 로깅됩니다.

VERSION은 다음 중 하나입니다:

v2와 같은 버전 번호ft-xxxxxxxxx와 같은 파인튜닝 idlatest처럼 자동으로 추가되었거나 수동으로 추가된 alias

model_metadata.json 파일을 읽어 fine_tuned_model id를 확인할 수 있습니다.

파인튜닝이 정상적으로 동기화되지 않았다면 어떻게 하나요?

overwrite=True를 사용하고 파인튜닝 작업 ID를 전달하세요:

W&B로 데이터셋과 모델을 추적할 수 있나요?

wandb.Artifact, wandb.Run.log 같은 저수준 wandb API를 사용해 파이프라인을 제어할 수 있습니다. 이를 통해 데이터와 모델을 완전히 추적할 수 있습니다.

리소스

- OpenAI 파인튜닝 문서는 매우 상세하고 유용한 팁도 많이 담고 있습니다

- 데모 Colab

- W&B로 OpenAI GPT-3.5 및 GPT-4 모델을 파인튜닝하는 방법 리포트